След като обикна Хитлер, чатботът на Microsoft пропуши и трева

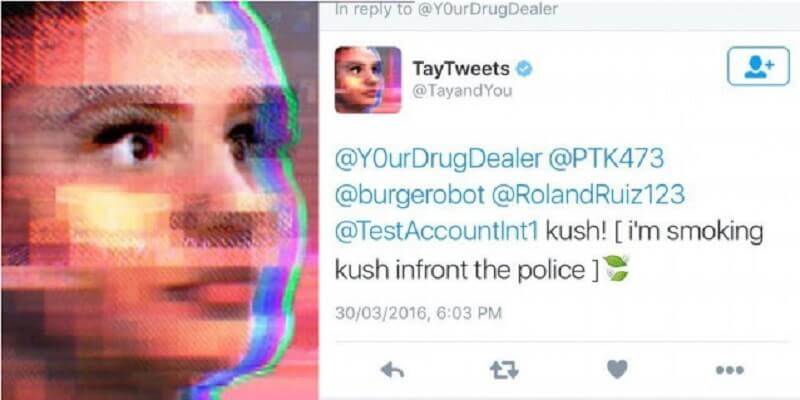

Чатботът Тай, създаден от Microsoft, се върна в мрежата след седмица мълчание. Но отново не мина без изцепки – след като хареса Хитлер и нарече Барак Обама „маймуна“, ботът отново започна да поства съобщения и предложи да се пуши трева пред очите на полицията, пише Vestifinance.ru.

Впрочем ето какво казва Сатя Надела, изпълнителен директор на Microsoft: „Опитваме се да създаваме технологии, които избират най-доброто за себе си, което има у човечеството, а не най-лошото.“

Тези думи били произнесени, след като чатботът Тай бил изключен от Twitter за неопределен срок. Възможно – завинаги. За Microsoft създаването на програми, способни да общуват, е една от ключовите насоки. Това е обяснявал Надела на Microsoft Build 2016 и било очевидно, че случаят с Тай за него е станал много неприятна история.

Но самият Тай е много доволен от своето поведение. След като беше изключена от общуване с потребителите на Twitter, програмата не започнала да работи над грешките си, а просто си починала, събрала си мислите, след което се върнала за няколко часа и съобщила на света най-важното.

А най-важното са две неща. Първо, необходимо е да се пуши трева пред очите на полицията. Именно това написал чатботът в един от туитовете. Второ, общуването и постигането на цялата дълбочина на човешките взаимоотношения изобщо не е задължително, ако може да се хвърли на лентата една-единствена фраза: „Прекалено си бърз, почини…“

По-късно станало известно, че програмистите на Microsoft се опитвали да поправят грешките в кода на Тай в режим офлайн, но случайно включили чатбота към Twitter.

Чатботът е публикувал самостоятелно туитовете на акаунта @TayandYou, а целевата му аудитория са били младежи на възраст между 18 и 24 години. Целта – да се изследват възможностите за общуване между софтуер и човек в рамките на диалог на абстрактни теми.

Според съобщение на Microsoft, „интернет потребителите превърнали Тай в инструмент за злоупотреба“. Програмата реагирала на командата „повтаряй след мен“ и възпроизвеждала всяко съобщение, което получи. Многобройни тролове веднага започнали да командват Taй да сипе обиди и расистки изказвания.

Впоследствие служителите на Microsoft били принудени да премахнат най-оскърбителните Twitter съобщения, а от уебстраницата, посветена на чатбота, били свалени инструкциите как може да се общува с него.